Lorsqu’on est webmaster, il arrive que l’on commette certaines erreurs sur son site qui ruinent toute la stratégie SEO. Dans cet article, nous parlerons du Spider Trap. Le concept peut vous sembler nouveau ; c’est pourtant un souci remarqué sur de nombreux sites, notamment les blogs, les sites de vente, e-commerce ainsi que les plateformes de réservation.

Qu’est-ce que le Spider Trap en SEO ?

Un Spider Trap, ou « piège à robots » en français, est une structure technique de votre site web qui crée un nombre infini ou excessif d’URLs. Concrètement, cela piège les crawlers des moteurs de recherche dans une série interminable de pages générées automatiquement.

Généralement, le spider trap n’est pas créé intentionnellement. Il résulte souvent d’une mauvaise configuration de votre CMS, d’un plugin mal paramétré sur WordPress, ou d’une architecture technique inadaptée, particulièrement sur les sites e commerce.

Pour vous donner un exemple concret : si chaque page produit de votre boutique en ligne génère automatiquement des URLs avec tous les filtres possibles (couleur, taille, prix, matière…), vous créez involontairement des milliers de pages similaires. Le moteur de recherche va alors gaspiller son temps et son énergie à crawler du contenu dupliqué au lieu d’explorer vos pages vraiment importantes.

Ce phénomène impacte directement votre budget de crawl, c’est-à-dire le nombre de pages que Google accepte d’explorer sur votre site dans un temps donné.

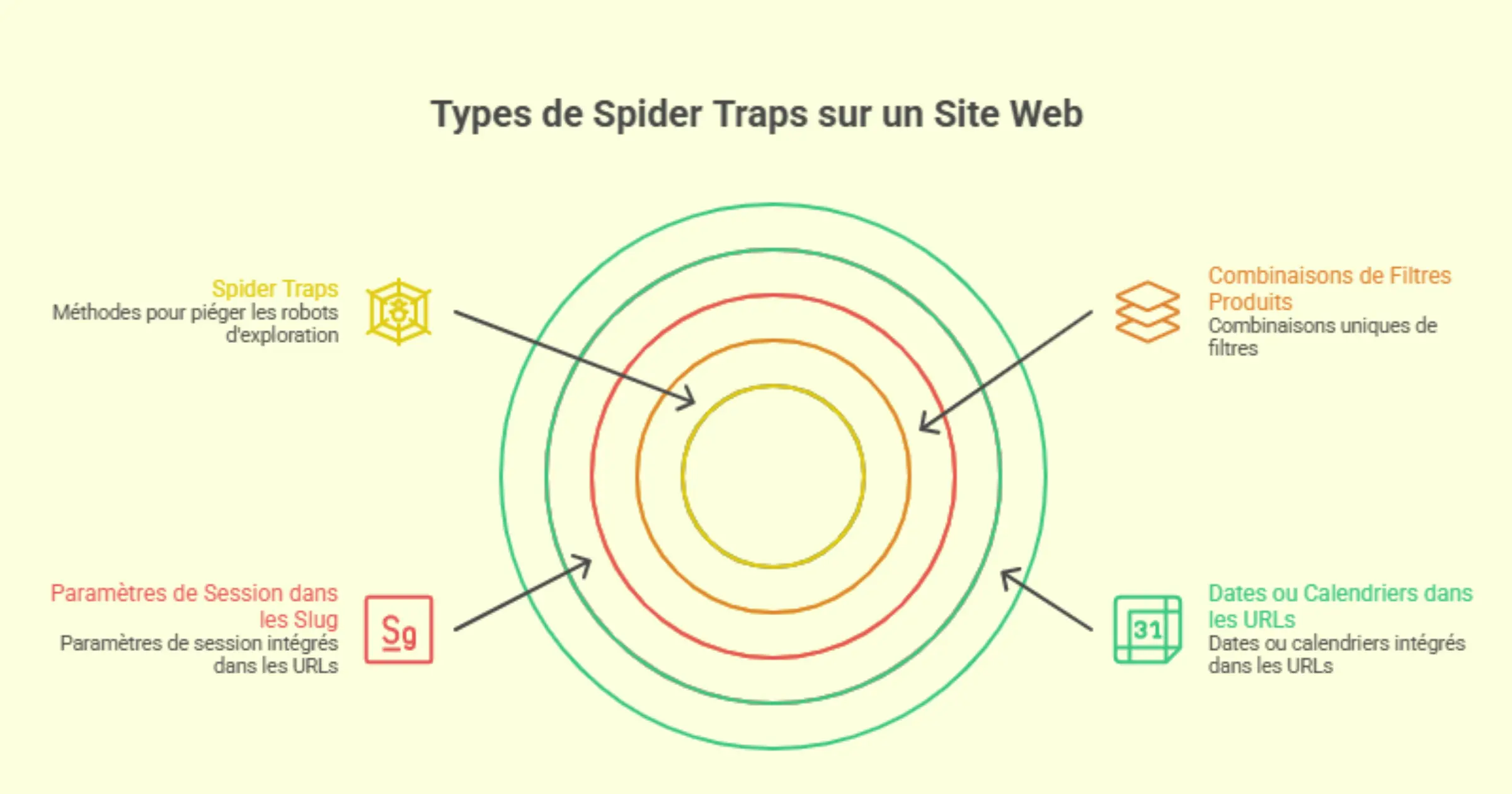

Quels sont les types de Spider Trap sur un site web ?

Les Spider Traps prennent différentes formes selon la configuration technique de votre site internet. Je vous présente ici les trois types les plus fréquents que j’ai pu observer lors de mes audits SEO.

Les combinaisons de filtres produits

C’est le piège classique des sites e commerce. Lorsque vous proposez des filtres pour aider vos visiteurs à affiner leur recherche (taille, couleur, marque, prix, matière), chaque combinaison génère potentiellement une nouvelle URL.

Prenons un exemple simple : vous vendez des chaussures. Un utilisateur peut filtrer par :

- Taille : 10 options

- Couleur : 8 options

- Marque : 15 options

- Prix : 5 tranches

Mathématiquement, cela représente 10 × 8 × 15 × 5 = 6000 URLs différentes pour une seule catégorie de produits. Multipliez ce chiffre par le nombre de catégories sur votre site, et vous obtenez des centaines de milliers de pages générées automatiquement.

Le problème ? Ces pages contiennent quasiment le même contenu, avec juste quelques produits différents. Pour les moteurs de recherche, c’est du duplicate content massif qui dilue la pertinence de votre site et gaspille votre précieux budget de crawl.

Les plateformes comme PrestaShop ou certains thèmes WordPress avec des plugins de filtrage sont particulièrement concernés par ce problème si elles ne sont pas correctement configurées.

Les paramètres de session dans les slug

Voici un autre piège technique sournois : les identifiants de session intégrés directement dans les URLs. Certains CMS ou frameworks génèrent automatiquement un identifiant unique pour chaque visiteur et l’ajoutent à l’URL.

Vous avez peut-être déjà vu ce genre d’adresses :

- monsite.com/page?sessionid=abc123

- monsite.com/page?sid=xyz789

- monsite.com/page?PHPSESSID=def456

Chaque fois que le robot de Google visite votre site, il reçoit un nouveau paramètre de session. Résultat : il pense découvrir une nouvelle page alors qu’il s’agit exactement du même contenu. Le crawler va alors parcourir votre site encore et encore, créant à chaque fois de nouvelles URLs avec de nouveaux identifiants.

C’est l’équivalent d’une boucle infinie pour le Googlebot. Au lieu d’indexer l’ensemble de vos pages existantes, le moteur d’indexation reste coincé sur les mêmes contenus avec des paramètres différents.

Les dates ou calendriers dans les URLs

Les systèmes de calendrier, de booking ou de réservation peuvent créer des Spider Traps redoutables. Si votre site permet de naviguer dans un calendrier pour choisir une date (hôtels, locations, événements, rendez-vous), vous générez potentiellement une URL pour chaque jour.

Imaginez un site de réservation d’hôtel. Chaque page peut avoir :

- Un calendrier permettant de sélectionner une date d’arrivée

- Un calendrier pour la date de départ

- Des liens « mois suivant » et « mois précédent »

Si ces interactions génèrent des URLs du type :

- monsite.com/hotel?checkin=2026-01-23&checkout=2026-01-25

- monsite.com/hotel?checkin=2026-01-24&checkout=2026-01-26

Vous créez littéralement des millions de combinaisons possibles. Le spider de Google peut naviguer indéfiniment dans ces calendriers, passant d’un mois à l’autre, d’une année à l’autre, sans jamais atteindre une « fin » logique.

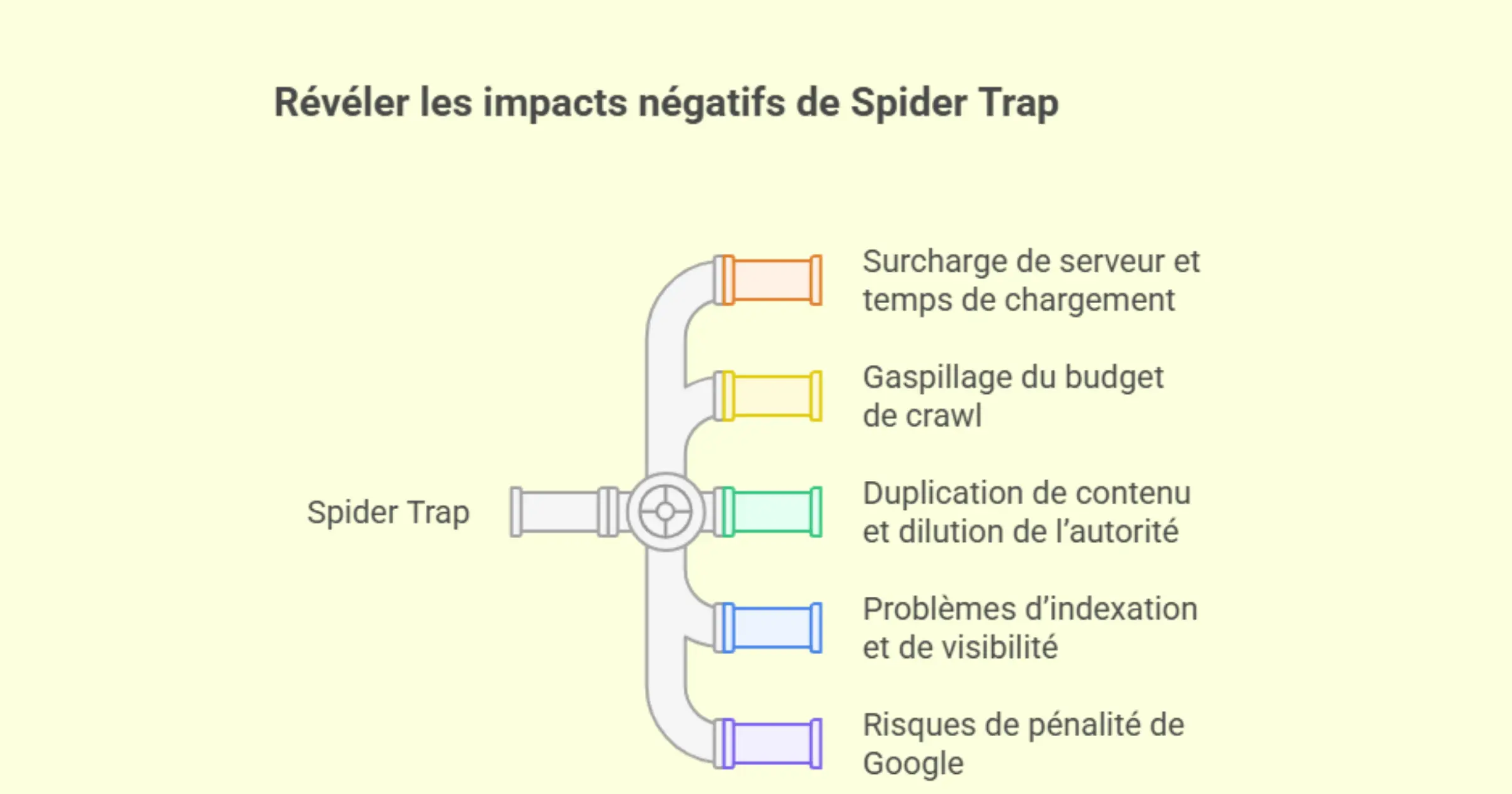

Quelles sont les conséquences de Spider Trap sur un blog ou site e-commerce ?

Les Spider Traps ne sont pas qu’un simple désagrément technique. Ils peuvent sérieusement compromettre votre stratégie de référencement et impacter négativement la performance globale de votre site. Voici les principales conséquences que j’ai observées.

Le surcharge de serveur et le temps de chargement

Quand le Googlebot se retrouve piégé dans une boucle, il va crawler des centaines, voire des milliers de pages en peu de temps. Cela génère une charge considérable sur votre serveur. Les conséquences sont directes : votre temps de chargement augmente pour les vrais visiteurs, votre expérience utilisateur se dégrade, et dans les cas extrêmes, votre hébergement peut même devenir temporairement inaccessible.

Un gaspillage du budget de crawl

C’est la conséquence la plus critique pour votre référencement.

Google alloue à chaque site un budget de crawl, c’est-à-dire un nombre limité de pages qu’il accepte d’explorer régulièrement. Si ce budget est gaspillé sur des milliers d’URLs générées par un Spider Trap, les robots n’ont plus assez de ressources pour crawler vos vraies pages importantes : vos nouveaux articles de blog, vos pages produits stratégiques, vos landing pages optimisées.

La conséquence est que vos nouvelles pages mettent des semaines à être indexées et vos mises à jour de contenus ne sont pas détectées rapidement. De plus, certaines pages profondes de votre arborescence ne sont tout simplement jamais explorées.

La duplication de contenu et la dilution de l’autorité

Les URLs générées par les Spider Traps contiennent généralement du contenu identique ou très similaire. Pour les algorithmes de Google, c’est du duplicate content.

Cette duplication massive envoie des signaux négatifs aux moteurs de recherche. Votre site paraît moins pertinent, moins qualitatif. Google ne sait plus quelle version de la page indexer et afficher dans la SERP.

Au lieu de concentrer l’autorité et la popularité sur une seule URL canonique, vous la dispersez sur des dizaines de variations. Cela fait que vos backlinks se répartissent sur plusieurs URLs ce qui dilue votre PageRank.

Des problèmes d’indexation et de visibilité

Avec un Spider Trap actif, vous perdez le contrôle de ce qui est réellement indexé. En analysant la Search Console ou en faisant une recherche Google avec la requête « site:votredomaine.com », vous découvrez peut-être des milliers de pages indexées que vous n’avez jamais voulu rendre publiques.

Ces pages parasites polluent votre index et réduisent le taux d’indexation de vos pages stratégiques. Google peut aussi décider de ne plus crawler certaines sections de votre site s’il détecte trop de contenu de faible qualité.

À terme, votre visibilité dans les résultats de recherche diminue, votre taux de clics baisse, et vous attirez moins de trafic qualifié vers votre site internet.

Des risques de pénalité de Google

Même si les Spider Traps ne sont généralement pas créés dans une intention de manipulation, Google peut les interpréter comme des tentatives de gonfler artificiellement le nombre de pages indexées. Les algorithmes comme Panda, qui visent à réduire la visibilité des sites de faible qualité, peuvent pénaliser votre site si une proportion trop importante de vos pages indexées est constituée de contenu dupliqué ou de faible valeur.

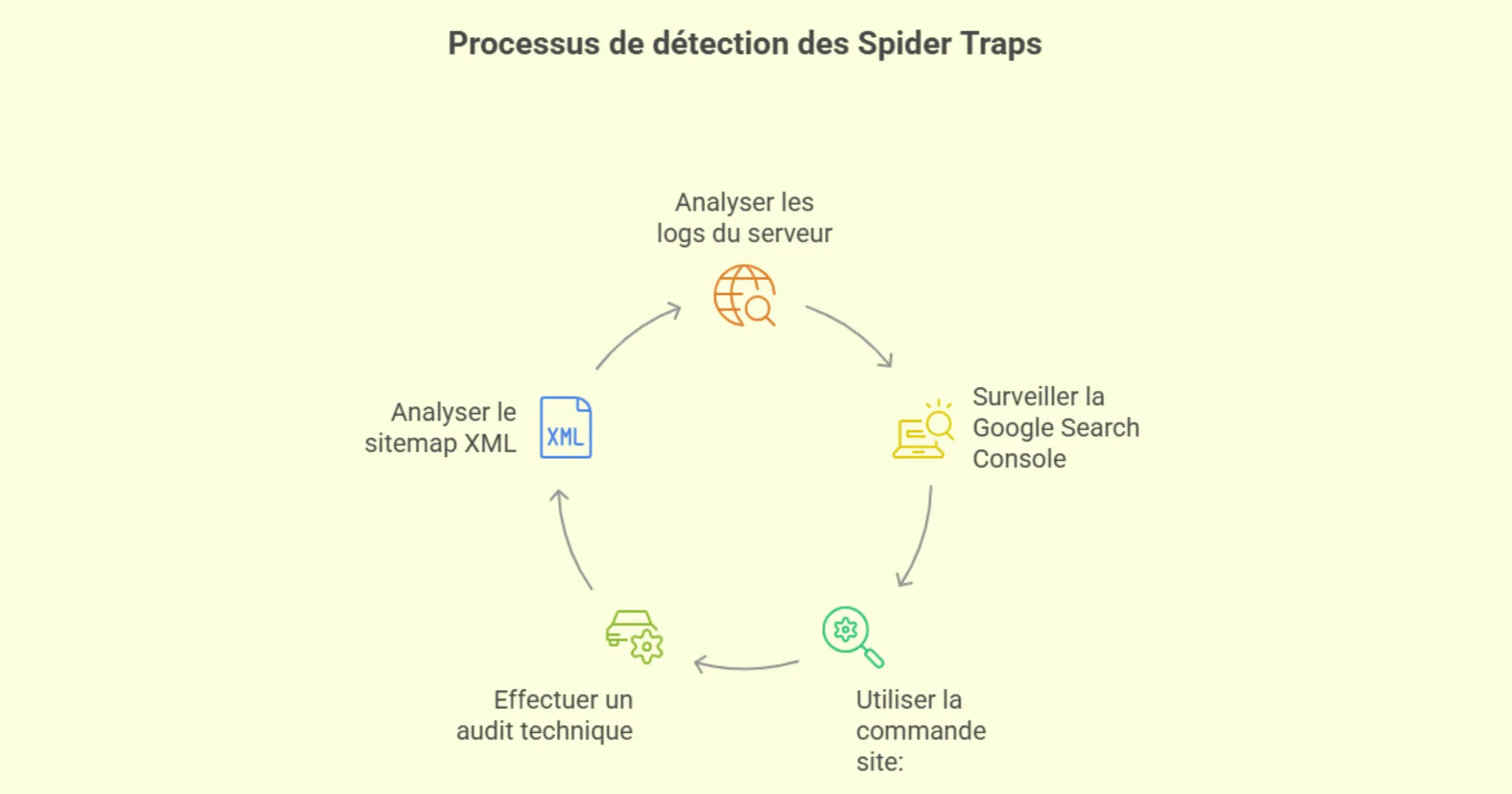

Comment détecter un Spider Trap en SEO ?

Maintenant que vous comprenez les risques, voyons comment identifier si votre site est victime d’un Spider Trap. Je vous partage les méthodes que j’utilise systématiquement lors de mes audits SEO.

L’analyse des fichiers de logs du serveur

C’est la méthode la plus précise pour comprendre le comportement réel des crawlers sur votre site. Vos logs serveur enregistrent chaque requête, y compris celles du Googlebot.

En analysant ces fichiers (souvent accessibles via votre hébergeur ou via des outils comme Screaming Frog Log File Analyser), vous pouvez identifier :

- Les URLs les plus crawlées

- Les sections où le robot passe le plus de temps

- Les patterns d’URLs anormaux

- Les pics de crawl inexpliqués

Si vous observez que le crawler visite des milliers de variations d’URLs avec des paramètres différents, c’est un signal d’alerte fort. Les logs vous montrent exactement où le spider se perd et combien de ressources il gaspille.

Surveillance de la Google Search Console

La Search Console est votre meilleur allié pour monitorer la santé de votre indexation. Dans la section « Couverture » ou « Pages », vérifiez le nombre de pages indexées. Si ce chiffre est anormalement élevé par rapport au nombre réel de pages sur votre site, c’est suspect.

Je vous invite donc à regarder « Pages explorées, actuellement non indexées ». Si Google explore massivement des URLs mais décide de ne pas les indexer, c’est souvent qu’il détecte du contenu dupliqué ou de faible qualité. A cela, si la section « Statistiques d’exploration » vous montre des pics inexpliqués, c’est que le robot se perd dans des boucles infinies.

La commande site: dans Google

Voici un test rapide que vous pouvez faire immédiatement. Tapez dans Google : site:votredomaine.com

Cette recherche affiche toutes les pages de votre site indexées par le moteur de recherche. Regardez attentivement les résultats :

- Combien de pages apparaissent ? Est-ce cohérent avec votre site ?

- Voyez-vous des URLs avec beaucoup de paramètres (?filter=, ?session=, ?date=) ?

- Des pages en double avec des variations minimes ?

- Des URLs que vous ne reconnaissez pas ou que vous n’avez jamais créées ?

Pour affiner, vous pouvez chercher des patterns spécifiques : site:votredomaine.com inurl:filter ou site:votredomaine.com inurl:session pour identifier les URLs problématiques.

Un audit technique avec un crawler SEO

Des outils comme Screaming Frog ou Ahrefs, ous permettent de crawler votre site comme le ferait Google. Configurez le crawler avec une limite haute (10 000 URLs par exemple) et lancez l’exploration.

Si l’outil continue indéfiniment à découvrir de nouvelles URLs, c’est un Spider Trap évident. Analysez ensuite :

- Les URLs découvertes : y a-t-il des patterns répétitifs ?

- Le contenu des pages : beaucoup de duplicate content ?

- La profondeur de crawl : des pages à 10, 15, 20 clics de la page d’accueil ?

- Les liens internes : certaines sections créent-elles des boucles ?

L’analyse du fichier sitemap XML ?

Votre sitemap XML liste normalement les pages que vous souhaitez faire indexer. Comparez son contenu avec ce que Google a réellement indexé (via la Search Console).

Si Google indexe des milliers de pages qui ne sont pas dans votre fichier sitemap, elles sont probablement découvertes via des liens internes générés automatiquement par votre CMS ou vos plugins. Inversement, si votre sitemap contient lui-même des milliers d’URLs avec des paramètres, c’est votre configuration qui génère le problème en amont.

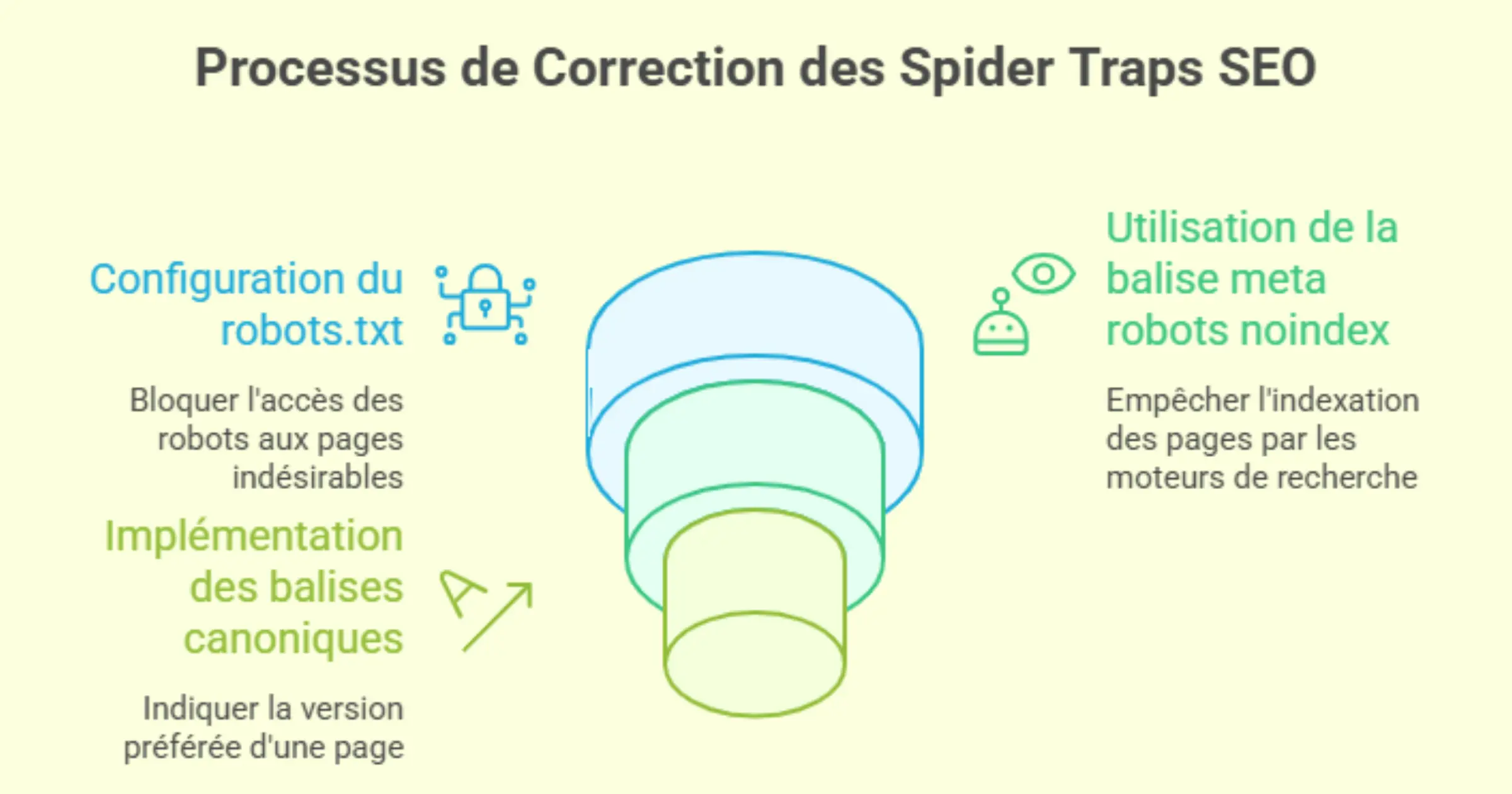

Comment corriger un Spider Trap SEO sur un site web ?

Une fois le diagnostic posé, passons à l’action. Voici les solutions concrètes que je vous recommande pour éliminer les Spider Traps et optimiser le crawl de votre site.

La configuration du fichier robots.txt

Le fichier robots.txt est votre première ligne de défense. Il indique aux robots des moteurs de recherche quelles sections de votre site ils peuvent ou ne peuvent pas explorer.

Pour bloquer le crawl des URLs avec paramètres problématiques, ajoutez des directives comme :

User-agent: *

Disallow: /*?sessionid=

Disallow: /*?sid=

Disallow: /*?filter=

Disallow: /*?date=Cette syntaxe interdit l’exploration de toute URL contenant ces paramètres, quelle que soit sa position dans l’arborescence.

Toutefois, le robots.txt empêche le crawl, mais n’empêche pas l’indexation. Une page bloquée par robots.txt peut quand même apparaître dans les résultats de recherche si elle reçoit des liens externes. C’est pourquoi il faut souvent combiner cette méthode avec d’autres.

L’utilisation de la balise meta robots noindex

Pour les pages que vous voulez vraiment exclure de l’index Google, la balise meta robots est plus efficace. Elle se place dans la section <head> de vos pages :

<meta name="robots" content="noindex, follow">Cette balise indique aux moteurs de recherche : « Ne mets pas cette page dans ton index, mais tu peux suivre les liens qu’elle contient ».

Ainsi, vous gardez le bénéfice du maillage interne (le robot peut suivre les liens pour découvrir d’autres pages), sans polluer votre index avec du contenu dupliqué.

Sur WordPress, de nombreux plugins SEO (Yoast, Rank Math, All in One SEO) permettent d’ajouter facilement cette balise sur certains types de pages. Sur PrestaShop ou d’autres CMS, vous devrez peut-être modifier les templates ou utiliser des modules dédiés.

Pour les pages de filtres produits, par exemple, vous pouvez configurer votre site pour qu’elles affichent automatiquement cette balise meta robots dès qu’un paramètre de filtrage est détecté dans l’URL.

L’implémentation des balises canoniques

La balise link rel= »canonical » est votre meilleure alliée contre le duplicate content. Elle indique à Google quelle version d’une page est la version « officielle » à indexer.

Sur chaque variation d’URL (avec filtres, paramètres, etc.), vous placez dans le <head> :

<link rel="canonical" href="https://monsite.com/page-principale" />Ainsi, toutes les variations pointent vers la même URL canonique. Google comprend que ces pages sont des duplicatas et concentre son attention sur la version principale.

Pour un site e commerce, cela signifie que toutes vos pages de catégories avec filtres devraient pointer vers la catégorie sans filtre. Pour les pages avec pagination, chaque page de la série peut pointer vers la page 1 (ou s’auto-canoniser si c’est pertinent).

Les balises canoniques sont particulièrement puissantes car elles consolident votre popularité et votre PageRank sur une seule URL, tout en permettant aux utilisateurs d’accéder à différentes versions de la page selon leurs besoins.

Conclusion

En conclusion, les spider traps sont des pièges techniques qui peuvent sérieusement handicaper votre stratégie de référencement naturel. Ils gaspillent en réalité votre budget de crawl, remplissent votre site avec du contenu dupliqué et diluent votre jus de liens SEO. Si vous le remarquez sur votre site, vous pouvez utiliser les techniques évoquées plus haut pour l’éviter.

FOIRE AUX QUESTIONS

Avez-vous une question sur le spider trap en SEO ? Je vous réponds dans cette section.

Quel est un exemple de spider trap pour Google ?

Si le robot de Google explore une page et trouve sur celle-ci 50 URLs normalement identiques mais mal gérées, il se mettra à les suivre et tombera potentiellement sur ces 50 URLs, qui pourraient chacune mener à 50 nouveaux liens, créant ainsi une boucle sans fin.

Comment éviter les pièges pour les crawlers sur mon site ?

Pour éviter que sur votre site, les robots ne tombent dans une boucle sans fin, commencez par configurer vos balises canoniques. Ensuite, ne permettez pas à vos utilisateurs de générer des liens dynamiquement.

C’est quoi un spider trap ?

En informatique comme en SEO, le spider trap désigne les pièges à robots. C’est une mauvaise structure mise en place sur un site qui fait qu’une fois sur le site, les robots ne peuvent s’en échapper, explorant en boucle la même page.

Comment détecter un spider trap sur mon site ?

Deux méthodes s’offrent à vous pour cela. La première, la plus efficace, mais complexe, est l’analyse des fichiers de logs. La seconde méthode est de faire un audit SEO et de comparer le nombre de pages à celui présent dans le sitemap du site.